미국 경마 - 파워볼실시간유튜브 -

미국 경마 - 2025년 실시간 업데이트

유럽 1위 방산 회사‘탈레스그룹’

패트리스 케인 회장 단독 인터뷰·기고

올 초부터 감지된 테크업계의 새로운 분위기는 미국 빅테크의 인공지능(AI) 모델을 위협하는‘중국산 AI’의 등장과 규제에 대한 세계 각국의 스탠스 변화로 요약됩니다.

중국의 AI스타트업‘딥시크(deepseek)’는 등장과 함께 전 세계에 충격을 줬습니다.

각국에서 딥시크 차단 움직임까지 일면서,시간이 갈수록 화제성은 다소 떨어지는 분위기지만 미국과 중국 두 강대국 간 AI패권 경쟁의 2막이 열렸다는 평가입니다.

개발 비용을 획기적으로 줄이면서도 AI 성능은 올리면서 고비용 구조인 미국 AI기업들에 대한 의존도를 낮출 수 있는 가능성과 중국 AI의 잠재력을 보여줬기 때문입니다.

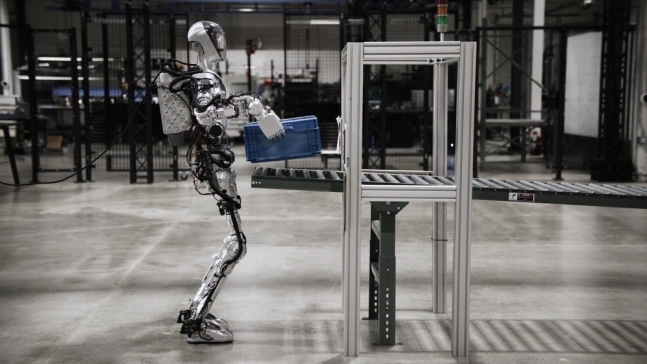

특히 중국 기업들이 AI와 밀접하게 연계해 또 다른‘게임 체인저’인‘휴머노이드’분야에서 치고 나가는 모습을 보여주면서 향후 강대국들의 기술 패권 경쟁이 더욱 치열해질 전망입니다.

피규어AI가 공개한 휴머노이드 로봇‘피규어01’모습.피규어AI지난 2월 10일 프랑스 파리에서 열린‘AI 정상 회의.

에마뉘엘 마크롱 프랑스 대통령이 의미심장한 메시지를 던졌습니다.

그는 “유럽이 세계 다른 나라들과 다시 보조를 맞춰야 한다”면서 “AI 규제를 단순화할 것”이라고 했습니다.이는 2년전 영국에서 열린 AI 정상 회의에서 규제 방안에 초점을 맞췄던 것과는 상반된 행보입니다.

그간 유럽은 AI 개발 경쟁에서 뒤처졌다는 평가와 함께‘규제’를 통해 외산 AI의 영향력 확장을 경계하고‘AI주권’을 지키는 전략을 고수해왔습니다.

하지만 그 사이‘미스트랄AI’등 프랑스의 AI스타트업들이 빠른 속도로 기술 추격에 성공했고,오픈소스 등을 활용해 상대적으로 적은 비용으로도 빅테크에 버금가는 AI를 만들 수 있는 길을 찾으면서 유럽의 AI 전략에도 변화가 일어나는 모양새입니다.

그간 <더테크웨이브>에서 수차례 강조드렸듯,AI라는 대세 기술 발전을 막을 수 있는 방법은 사실상 없어보입니다.

이제부터의 관건은 누가 더 빠르게 기술을 선점하느냐,인류가 어떻게 AI를 현명하게 통제하는 방법을 찾을 수 있느냐에 달려있을 것입니다.

사람들의 실생활에 AI가 적용되고 수십억명이 AI챗봇을 사용하게 된 현실에서 “당분간 AI 연구를 중단하자”는 말은 공허하게 들리기까지 합니다.뉴욕타임스는 “AI 종말론자들이 점점 설 자리를 잃고 있다”고 했죠.

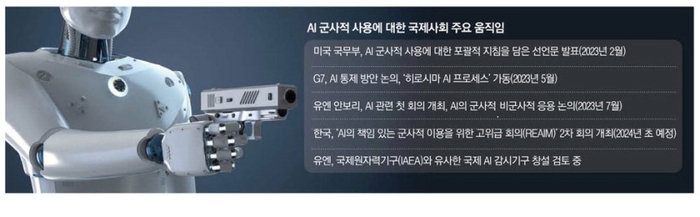

거대한 AI 물결 속 군사용 AI에 대한 관심도 높아지고 있습니다.그간 AI의 군사적 사용이 금기시되는게 불문율처럼 여겨졌다면 최근에는 대놓고 군사용 AI를 개발하는 움직임이 눈에 띕니다.

메타,오픈AI,구글,미스트랄AI 같은 유수의 테크기업들은 방산업체들과 협력하거나 관련해서 자체 팀을 꾸리는 등 군사용 AI에 대한 준비에 착수했습니다.

특히 중국의 AI와 로봇 굴기가 상당 수준에 올라왔음을 전 세계가 목격하면서 국가 안보를 위해 군사용 AI에 대한 대비책을 분주하게 마련하는 분위기죠.

패트리스 케인 탈레스그룹 회장.탈레스이번주 <더테크웨이브>에서는 페트리스 케인 탈레스그룹 회장과의 인터뷰를 통해 현 상황을 진단해보겠습니다.그는 11년째 유럽 1위 방산업체인 탈레스그룹을 이끌고 있는 유럽의 방산 거물입니다.

파리에서 열린‘AI 정상 회의’에 최근에 참석한 케인 회장이 한국 독자들에게 전하는 메시지도 전합니다.그는 “사이버 보안 보호 없이는 AI는 우리가 감당할 수 없는 도박”이라는 특별 기고문을 본지에 전달해왔습니다.

케인 회장은 “AI 자체는 필수 불가결한 존재가 되어가고 있다.AI의 효율성은 타의 추종을 불허하며 어떤 기업이나 정부도 무시할 수 없는 유망한 이득을 약속하고 있다”면서 “AI는 전기만큼이나 우리 삶에 필수적인 요소가 될 것이며 이에 대한‘사이버 보안’이 매우 중요하다”고 강조했습니다.

중국의 진격 “놀랍지 않다”···군사 전용 AI의 잠재력

패트리스 케인 탈레스그룹 회장은 기자와의 서면 인터뷰에서 중국의 AI 약진에 대해 “중국이 AI분야에서 중요한 플레이어가 된 것은 놀라운 일이 아니다”라면서 “다른 생성AI 사례와 마찬가지로 딥시크와 같은 기술은 방위 분야의 특정 사례와 관련이 있을 수 있다”고 말했습니다.

특히 그는 국방과 방위산업에 특화한 AI 개발의 필요성과 앞으로의 경쟁 구도를 강조했습니다.

케인 회장은 “예컨대 AI는 제트기를 타고 있는 조종사나 임무를 조정하는 동안 직원에게 자연어로 정보를 추출하고 전달하는 데 일부 도움이 될 수 있다”면서도 “AI를 위한 대부분의 국방 애플리케이션은 이처럼 단순하거나 특정 기술에 기반하지 않는다.센서를 더 스마트하게 만들거나 드론을 더 자율적으로 만들고,임무 계획을 더 효율적으로 하려면 다른 유형의 AI가 필요하다”고 설명했습니다.

그는 “군대는 딥시크나 챗GPT와 같은 데이터에만 기반한 도구로는 충족할 수 없는 구체적인 요구 사항을 가지고 있고,생사가 걸린 상황에서는 절대적인 신뢰성을 원한다”고 말했습니다.

AI를 군사적으로 적용하기 위해서는 AI에 의해 기계가 어떻게 작동하고,AI로 나오는 결과에 대해 속속들히 알고 있어야 한다는 설명으로 풀이됩니다.

케인 회장은 “이러한 조건들이 국방과 같은 중요한 애플리케이션을 위해 특별히 설계된 하이브리드라고 부르는 특정 AI 모달리티를 탈레스그룹이 개발하고 있는 이유”라고 설명했습니다.

AI 군사적 사용에 따른 각국 움직임.매경DBAI 뿐 아니라 AI를 탑재해 진화하는 로보틱스도 군사 분야에 접목돼 무궁무진한 발전이 예고됩니다.

앞서 세계경제포럼(WEF)은‘2016 세계 위험 보고서’에서 살인 로봇을 지목해 “실현 가능성이 높아지고 있으며 기존 전쟁의 규칙을 뒤흔들 것”이라고 명시하기도 했죠‘인간군인’대신‘살인로봇’들이 전쟁을 벌이는 일이 현실화할 수 있는 것입니다.

‘꿈의 AI’로 불리는 인공일반지능(AGI)이 AI의 군사화를 현실화하는‘트리거’가 될 수 있다는 전망도 있습니다.AGI란 주어진 모든 상황에서 인간처럼 추론,학습,문제 해결 능력을 갖춘 강력한 AI를 말합니다.

사실 이는 1997년 마크 구브루드 노스캐롤라이나대 교수가 자기 복제 시스템을 갖춘 군사용 AI 출현을 예고하면서 처음 사용한 개념입니다.테크업계에서는 AGI를 인간을 뛰어넘는 초지능AI로 가는 단계로 보고 있습니다.

“사이버 보안 없인 AI 감당 불가능”

케인 회장은 사이버 보안의 중요성을 거듭 강조했습니다.AI 발전과 함께 사이버 보안은 군사 분야의 핵심으로 떠오르는 영역입니다.

그는 “AI에 대한 공개적인 논의는 주로 윤리,잘못된 정보,그리고 미래의 직업에 초점을 맞추고 있지만 중요한 문제는 AI 자체의 보안”이라면서 “AI가 사회의 거의 모든 부분에 내재되어 있기 때문에 자칫 잘못되면 모든 것을 산산조각 낼 수 있는 거대하고 상호 연결된 시스템이 만들어진 셈”이라고 했습니다.

과연 우리는 위험에 대비하고 있을까요.

케인 회장은 “질병 진단부터 민감한 위치에 대한 물리적 접근 관리에 이르기까지 AI가 작업을 더 많이 통제할 수 있게 되면서 사이버 공격의 여파는 기하급수적으로 커지고 있지만,놀랍게도 일부 AI는 강력한 만큼 취약하다”고 경고했습니다.

그에 따르면 AI를 공격하는 두 가지 중요 방법이 있습니다.

첫번째는 개인 건강 기록부터 민감한 기업 기밀에 이르기까지 모든 것을 침해하는 데이터를 훔치는 것입니다.

해커는 의료 데이터베이스를 악용하거나 챗봇을 속여 자신의 안전망을 우회하는 등 모델을 속여 보안 정보를 뱉어내게 할 수 있습니다.

두번째는 모델 자체를 방해하여 위험한 방식으로 결과를 왜곡하는 것입니다.

예컨대 AI로 구동되는 자동차가‘정지’표지판을‘70mph’등으로 잘못 읽게 되면 큰 위협이 닥칠 수 있죠.AI가 확장됨에 따라 이처럼 가능한 공격 목록은 점점 더 늘어날 것이라는 게 케인 회장의 예상입니다.

그는 “이러한 위험으로 인해 AI를 포기하는 것은 가장 큰 실수가 될 것”이라며 “보안을 위해 경쟁력을 희생하는 것은 조직이 빠르게 필수가 되고 있는 기술에 대한 경험과 통제력을 제3자에게 의존하게 만들 것”이라고 지적했습니다.

사이버 공격 리스크 대비 3가지 비책

AI의 위험을 감수하지 않고도 AI의 이점을 어떻게 얻을 수 있을까요.

케인 회장은 세 가지 비책을 조언했습니다.

첫째,AI를 현명하게 선택하라.그는 “모든 AI가 공격에 똑같이 취약한 것은 아니다”라고 강조합니다.예를 들어,대형 언어 모델은 방대한 데이터 세트와 통계적 방법에 의존하기 때문에 매우 취약하다는 설명입니다.AI에 모든 것을 내어주기 전에 조직이 사용하는 AI의 보안성을 확인하고,현명하게 선별해 사용하는 것이 필요하다는 의미로 해석됩니다.

둘째,입증된 방어 기능을 배포,사용하라.케인 회장은 “심볼릭 또는 하이브리드 모델과 같은 다른 유형의 AI는 데이터 집약적이지 않고 명시적인 규칙에 따라 작동하기 때문에 해독하기가 더 어렵고,입증된 방어 기능을 배포한다”고 조언했습니다.

그는 특히 “디지털 워터마킹,암호화,맞춤형 학습과 같은 도구는 새로운 위협에 대비하여 AI 모델을 강화할 수 있다”고 설명했습니다.예를 들어 탈레스의‘배틀 박스’를 통해 사이버 보안 팀은 AI 모델을 스트레스 테스트하여 해커가 취약점을 악용하기 전에 취약점을 찾아 수정하고 있다는 설명입니다.

셋째,조직의 사이버 보안 수준을 향상 시켜라.

케인 회장은 “AI는 독립적으로 운영되는 것이 아니라 더 큰 정보 생태계의 일부”라면서 “전통적인 사이버 보안 조치는 AI 시대에 맞게 강화되고 맞춤화되어야 한다”고 강조했습니다.이는 직원 교육에서 시작되며,결국 인간의 실수는 사이버 보안 시스템의 아킬레스건으로 남아 있다는 설명입니다.

탈레스그룹 개요.매경DBAI에 의한 위협을 결코 간과해선 안되며,이에 지금부터 대비해야 한다는 것이 그가 거듭 강조한 메시지입니다.

“흔히 AI를 둘러싼 싸움이 악의적인 행위자와 무의식적인 피해자 간의 지속적인 충돌의 장이라고 간과할 수 있다.하지만 이번에는 그 어느 때보다 큰 위험이 따른다.AI의 보안이 우선시되지 않으면 AI의 힘을 이용해 피해를 입히려는 사람들에게 통제권을 넘겨줄 위험이 있다.” (패트리스 케인 탈레스그룹 회장)

양자컴도 사이버 위협 리스크

작년 7월 5년만에 한국을 찾은 케인 회장은 기자와 만나 양자컴퓨터에 의한 사이버 공격의 위험성을 수차례 경고한 바 있습니다.

그는 “클라우드나 데이터센터에 거의 모든 핵심 정보가 모이는‘초연결’시대에 기존 암호체계를 완전히 무너뜨릴 수 있는 것이 양자 기술이다.앞으로 사이버 보안 분야의 핵심 화두가 될 것”이라고 경고했죠.

그는 “사이버 공격은 매우 두려운 속도로 계속 나타나고 있다”며 “특히 양자 기술은 현재 완전히 상용화되지 않았지만,미래에 일상화될 것이고 이에 따른 잠재적 위협을 수많은 기업이 인지하고 있다”고 말했습니다.

테크업계에서 양자컴퓨터의 사이버 공격을 염려하는 까닭은 기술 발전 속도가 빠르기 때문입니다.

양자컴퓨터란 양자 원리에 따라 병렬 처리가 가능한 미래형 컴퓨터를 의미합니다.일반 컴퓨터가 0 또는 1의 숫자를 활용하는 것과 달리,양자컴퓨터는 00,01,

사설토토 생년월일10,11 등 4가지 상태를 사용하죠.

이 때문에 일반 컴퓨터가 100만번 연산해야 푸는 문제를 양자컴퓨터는 단 1000번의 계산으로 해결할 수 있습니다.오늘날 양자컴퓨터는 특정 영역에서 일반 컴퓨터를 능가한‘양자 우위’를 달성한 상태로 평가됩니다.

특히 양자컴퓨터를 갖고 사이버 상에서 공격이 이뤄질 경우 큰 피해가 예상된다는 게 케인 회장의 우려입니다.

그는 “이미 양자 기술이 컴퓨터,스마트폰,레이더,GPS,반도체 등 여러 분야에 접목되고 있지만 우리가 현재 보고 있는 것은 빙산의 일각에 불과하다.이 기술로 세상이 완전히 확장되고 바뀔 것으로 예상해 탈레스도 여기에 많은 투자를 하고 있다”고 했습니다.

특히 양자컴퓨터의 등장으로‘사이버 보안’의 판이 완전히 뒤바뀔 수 있다고 케인 회장은 강조합니다.

컴퓨팅 속도가 엄청나게 빠른 양자컴퓨터의 특성상 기존 암호체계를 수초 안에 해독할 수 있고,이를 활용한 사이버 공격 등으로 기존 보안체계가 위험에 빠질 수 있어서죠.

양자 기술로 암호체계가 무너지면 암호화로 보호하는 통신이나 데이터가 모두 공격자에게 노출될 수 있는 셈입니다.

정보기술(IT) 업계 일각에서는 양자컴퓨터가 10년 내에 기존 암호 시스템을 깰 수 있을 만큼 강력해질 것으로 예상하고 있어요.사이버 공격 등으로 확장 가능한 양자컴퓨터가 2030년께 등장할 것이라는 전망까지 나오고 있죠.

미국 정부는 양자컴퓨터가 기존 암호 시스템을 무력화할 수 있다는 우려 속에 민감한 안보·기술 프로젝트부터 관련 암호화를 적용해 2035년까지 완료한다는 계획을 밝힌 바 있습니다.

마치며

각국의 AI 경쟁이 점입가경으로 치닫고 있습니다.

AI와의 기술 시너지로 인해 휴머노이드,드론 등의 상용화와 기술 다각화 속도도 놀랍도록 빠른 수준입니다.이러한 기술 패권 경쟁에서 뒤처지는 것은 경제를 넘어 국가 안보에도 치명적인 영향을 미칠 수 있다는 분석입니다.

AI 기술 개발에 있어 기술을 상용화하는‘창’뿐만 아니라 기술로 인한 역효과나 적국이나 위협 세력으로부터의 공격에 대비하는‘방패’개발에도 소홀히 해서는 안된다는 것이 유럽 방산 거물의 조언입니다.

우리는 과연 준비가 돼 있을까요.이에 대해서만큼은‘분열’이 아니라 단합된 행동이 필요한 시점입니다.골든타임이 지금도 흘러가고 있습니다.

마지막으로 패트리스 케인 회장의 특별 기고문 전문(원본)을 공유하며 이번주 <테크웨이브>를 마치겠습니다.

Without proper cybersecurity protections,AI is a gamble we can‘t afford

By Patrice Caine

패트리스 케인 탈레스그룹 회장.탈레스The AI debate is raging,and skepticism is high.But AI is here to stay.While some headlines criticise tech giants for AI-driven social media or questionable consumer tools,AI itself is becoming indispensable.Its efficiency is unmatched,promising gains that no business or government can ignore.

Very soon,AI will be as integral to our lives as electricity – powering our cars,shaping our healthcare,securing our banks,and keeping the lights on.The big question is,are we ready for what comes next?

The public conversation around AI has largely focused on ethics,misinformation,and the future of work.But one vital issue is flying under the radar: the security of AI itself.With AI embedded in nearly every part of society,we’re creating massive,interconnected systems with the power to shape – or,in the wrong hands,shatter – our daily lives.Are we prepared for the risks?

As we give AI more control over tasks – from diagnosing diseases to managing physical access to sensitive locations – the fallout from a cyberattack grows exponentially.Disturbingly,some AIs are as fragile as they are powerful.

There are two primary ways to attack AI systems.The first is to steal data,compromising everything from personal health records to sensitive corporate secrets.Hackers can trick models into spitting out secure information,whether by exploiting medical databases or by fooling chatbots into bypassing their own safety nets.

The second is to sabotage the models themselves,skewing results in dangerous ways.An AI-powered car tricked into misreading a “Stop” sign as “70 mph” illustrates just how real the threat can be.And as AI expands,the list of possible attacks will only grow.

Yet abandoning AI due to these risks would be the biggest mistake of all.Sacrificing competitiveness for security would leave organisations dependent on third parties,lacking experience and control over a technology that’s rapidly becoming essential.

So how do we reap AI’s benefits without gambling on its risks?Here are three critical steps:

Choose AI wisely.Not all AI is equally vulnerable to attacks.Large language models,for example,are highly susceptible because they rely on vast datasets and statistical methods.But other types of AI,such as symbolic or hybrid models,are less data-intensive and operate on explicit rules,making them harder to crack.

Deploy proven defences.Tools like digital watermarking,cryptography,and customised training can fortify AI models against emerging threats.For instance,Thales’s “Battle Box” lets cybersecurity teams stress-test AI models to find and fix vulnerabilities before hackers can exploit them.

Level-up organisational cybersecurity.AI doesn’t operate in isolation – it’s part of a larger information ecosystem.Traditional cybersecurity measures must be strengthened and tailored for the AI era.This starts with training employees; human error,

스포츠 토토 합법 제로놀이터after all,remains the Achilles’heel of any cybersecurity system.

Some might think the battle over AI is just another chapter in the ongoing clash between bad actors and unwitting victims.But this time,the stakes are higher than ever.If AI’s security isn’t prioritised,we risk ceding control to those who would use its power for harm.

The author is CEO of Thales Group.

<황순민 기자의‘더테크웨이브’> 연재를 시작합니다.기술(Tech)이 세상을 더 나은 곳으로 만들리라 믿습니다.혁신적인 서비스로 인류를 진보시키는 최신 기술 동향과 기업 사례를 소개하겠습니다.네이버 기자페이지를 구독하시면 다음 기사를 쉽게 받아보실 수 있습니다.

The 100% privacy-safe noise & occupancy solution